La plataforma puede «bajar» los videos que tengan imágenes y apología del dictador.

Como en el entorno físico, el espectro digital debe estar regulado por un mínimo de lineamientos que hagan posible que la convivencia sea lo menos dañina posible. Las redes sociales suelen estar plagadas de noticias falsas, desinformación, teorías de la conspiración, discursos de odio y YouTube, la plataforma de videos de Google, no se salva de este tipo de contenido.

Cada minuto se suben a YouTube 500 horas de contenido, por lo que su misión para filtrar el contenido que cumple las normas de la comunidad del que no las cumple es una labor compleja que requiere del trabajo conjunto entre un equipo de más o menos 10,000 personas y una avanzada tecnología de aprendizaje automático.

Si bien la inteligencia artificial es responsable de detectar el 90% de los contenidos que son calificados como potencialmente infractores de las normas de la comunidad de YouTube, se requiere la intervención humana en los casos que deben ser tratados con mayores matices, donde el contexto del contenido del video es crucial para que sea permitido o no en la red.

En una conferencia de prensa global a la que Forbes México tuvo acceso, la vicepresidenta de Gestión de Productos de YouTube a nivel global, Jennifer Flannery, compartió un ejemplo para entender cómo funciona la conjunción de la tecnología de aprendizaje automático con el equipo de personas que intervienen en la revisión del cumplimiento de las normas.

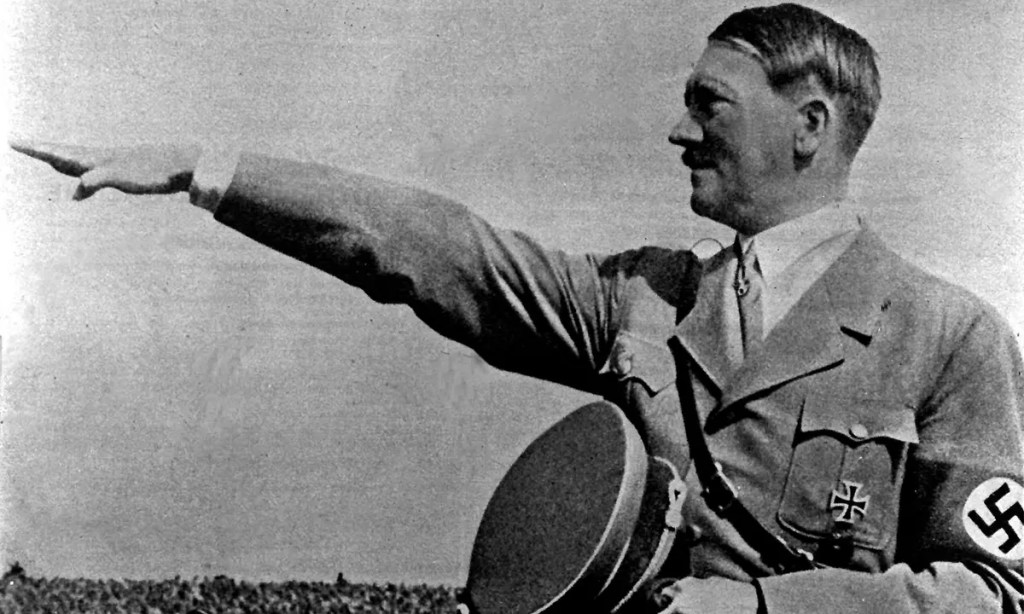

“Si se sube un discurso de Hitler en los congresos de Núremberg sin ningún contexto, ese contenido puede infringir nuestra política sobre incitación al odio. No obstante, si ese mismo discurso se enmarca en un documental que condena las acciones de los nazis, probablemente consideremos que cumple nuestras directrices de contenido con fines educativos, documentales, científicos o artísticos (EDSA)”, explicó.

Solo el contexto permite determinar que el contenido del video que habla del discurso de Hitler tiene fines educativos, documentales, científicos o artísticos. Si el contenido del video no tuviera el suficiente contexto infringiría las políticas de YouTube y hacer esa distinción resulta más difícil para un modelo de aprendizaje automático que a los moderadores de contenido de la plataforma.

“Este es uno de los motivos por los que aplicar medidas de cumplimiento es fundamentalmente una responsabilidad compartida. Además, deja claro por qué el razonamiento humano siempre será un factor importante de nuestro proceso. En el caso de la mayoría de los contenidos que pueden infringir las políticas de YouTube, los modelos únicamente marcan el contenido para que los moderadores lo revisen antes de que se tome ninguna medida”, refirió Flannery.

Matt Halprin, vicepresidente y director de Confianza y Seguridad de YouTube a nivel mundial, puso un ejemplo más actual. Los videos que se suben a la plataforma y describen la acción militar de Rusia sobre Ucrania como “desnazificación”, “acción de mantenimiento de la paz” o simplemente niegan la invasión son calificados como incitación al odio y por lo tanto rompen las normas.

“El mundo evoluciona muy deprisa y nuestras políticas tienen que seguirle el ritmo. Por eso, revisamos las políticas frecuentemente para asegurarnos de que, igual que pasa con las leyes que rigen la sociedad en la que vivimos, se ajustan a los cambios que se producen tanto dentro como fuera de nuestra plataforma”, comentó el directivo.

De acuerdo con ambos directivos de YouTube, la mayor parte del contenido no infringe las normas de la comunidad de la plataforma, pero “no paramos de buscar vacíos legales que puedan surgir y nuevos riesgos que pongan a prueba nuestras políticas”. Durante la pandemia por Covid-19 no faltó el contenido con noticias falsas o desinformación que generaba consecuencias en el mundo físico.

“Cuando, a raíz de la difusión de afirmaciones de que la tecnología 5G estaba relacionada con la propagación del Covid-19, se dañaron torres de telefonía móvil en el Reino Unido, tomamos medidas rápidamente para prohibir ese tipo de opiniones.

“También prohibimos las afirmaciones que puedan dañar significativamente a las instituciones democráticas, como los casos en que se intenta confundir a las personas con respecto a los procesos electorales (por ejemplo, cuando se divulga información falsa sobre los plazos, los lugares o los requisitos para votar)”, indicó Matt Halprin.

Ya lo dijo Halprin, el mundo evoluciona muy deprisa y las políticas de YouTube tienen que seguirle el ritmo. Una vez que la compañía detecta un ámbito donde se necesita una nueva política, entra en juego el equipo de Confianza y Seguridad, que se encarga de crear una solución personalizada.

“Para empezar, evaluamos ciertos aspectos. ¿Con qué frecuencia se encuentra este tipo concreto de contenido dañino en YouTube? ¿En qué medida puede aumentar su volumen? ¿Cómo abordan este contenido nuestras Normas de la Comunidad? Llegados a este punto, vemos entre docenas y cientos de videos para analizar las posibles repercusiones de distintas políticas”, explicó.

Las políticas no se elaboran para un video en concreto, sino que la empresa piensa en cómo una norma puede impactar a todos los videos para saber cuáles se retirarían y cuáles podrían seguir publicados si entrara en vigor la nueva política.

Tras concluir esta extensa investigación, el equipo presenta diferentes opciones sobre los límites de las políticas y detalla qué videos se retirarían o aprobarían en cada caso (así como las diferentes medidas por incumplimiento de políticas, como las retiradas o la aplicación de restricciones de edad).

Se elige uno de esos borradores, si se apega a los objetivos de YouTube como “mitigar los daños en el mundo real y, al mismo tiempo, preservar la libertad de expresión o permitir que los moderadores de contenido de todo el mundo puedan aplicar medidas coherente cuando se incumplan las políticas, la política es revisada por un grupo de ejecutivos de la compañía”.

La aprobación definitiva corresponde a los cargos más importantes, incluidos el director de Producto y la CEO de YouTube. Si se producen discrepancias constantes entre los equipos con respecto a los límites definidos, la política se devuelve al equipo que se encarga de elaborarlas.

En todo este proceso YouTube colabora con terceros especializados en temas como la incitación al odio o el acoso, con autoridades gubernamentales sobre cuestiones como extremismo violento o seguridad infantil o con organizaciones no gubernamentales.

“Gracias a los expertos, podemos prever la forma en que los eventos internacionales pueden acarrear la difusión contenido dañino en nuestra plataforma y nos ayudan a descubrir puntos ciegos en nuestros sistemas que pueden aprovechar los agentes perniciosos y nos ofrecen recomendaciones sobre actualizaciones”, señalaron los directivos de YouTube.

¿Cómo se aplican las normas?

Aunque también hay un componente reactivo, es decir, YouTube actúa cuando un video que infringe las normas de la comunidad ya está disponible en la plataforma, la empresa prioriza el trabajo preventivo. “Contamos con un largo proceso diseñado para proporcionar visibilidad a nuestros equipos sobre temas que puedan surgir antes de que lo hagan o de que se propaguen en nuestra plataforma”.

Esa visibilidad se la da el Intelligence Desk, un equipo del área de Confianza y Seguridad de YouTube formado por antiguos miembros de agencias de inteligencia gubernamentales. Se trata de analistas especializados que identifican tendencias que pueden infringir las políticas, ya sean nuevas vertientes de desinformación, retos de Internet que resulten peligrosos, entre otro tipo de contenido. También monitorean teorías de la conspiración, ideologías extremistas.

“A partir de los datos recogidos por Intelligence Desk, actualizamos nuestras políticas sobre la incitación al odio y el acoso para atajar de manera más eficaz las teorías conspirativas dañinas en nuestra plataforma”, detallaron los directivos en el encuentro con medios de comunicación de todo el mundo.

Para la detección de los videos que pueden infringir las normas, como ya se dijo, ocurre un trabajo conjunto entre personas y tecnología de aprendizaje automático. Es decir, para que una política se lance y aplique correctamente, tanto los agentes humanos como los sistemas informáticos deben colaborar para lograr que las revisiones de contenido tengan un alto nivel de precisión.

Explicó la compañía: “para empezar, proporcionamos directrices de acción (una explicación detallada de qué se considera contenido que infringe las políticas) a nuestro equipo de moderadores de contenido más experimentado y le pedimos que distinga qué materiales incumplen nuestras políticas y cuáles no”.

“Si con esas directrices logran un nivel de precisión alto, ampliamos ese grupo de pruebas: incluimos a cientos de moderadores con diferentes orígenes, idiomas y niveles de experiencia. Llegados a este punto, comenzamos a revisar las directrices para que un conjunto más amplio y diverso de moderadores pueda interpretarlas correctamente sin problemas”, agregó.

Este proceso puede durar meses y solo se completa cuando el grupo alcanza un grado de precisión similar. Los resultados de estos análisis ayudan a YouTube a entrenar su tecnología de aprendizaje automático para detectar a gran escala el contenido que pueda infringir las políticas.

Una vez que concluye este periodo de pruebas, la política puede entrar en vigor, sin embargo, se sigue evaluando y mejorando. Si es necesario se redactan modificaciones para abordar los vacíos legales.

Para evaluar la eficacia de sus medidas de cumplimiento, compartió Jennifer Flannery, YouTube ha implementado una métrica llamada “tasa de visualización de videos infractores”, que indica cuántas visualizaciones consiguen en YouTube los materiales que incumplen las políticas.

Desde julio hasta septiembre de este año, la cifra osciló entre un 0.10 y un 0.11 %; esto quiere decir que, por cada 10,000 visualizaciones, entre 10 y 11 correspondieron a contenido que infringía las normas de la comunidad de YouTube.

El número de apelaciones que interponen los responsables de los videos son otro indicador. Durante el mismo periodo antes mencionado YouTube retiró 5.6 millones de videos por infringir las normas y se apelaron unas 271,000 retiradas. Tras revisar las apelaciones, se restauraron apenas 29,000 videos, aproximadamente.

“Aunque las métricas como las apelaciones, las restauraciones o la tasa de visualización de videos infractores no son una solución perfecta para conocer nuestro grado de precisión o coherencia, sí que nos permiten establecer valores de referencia a largo plazo”, aseveró Jennifer Flannery.

Texto original: Forbes México

Deja un comentario